موقف بنجيو من الكذب على الشات بوت

أثار بنجيو، الملقّب بعرّاب الذكاء الاصطناعي، جدلاً واسعاً بعدما صرّح بأن الكذب على روبوتات المحادثة قد يكون الطريق الوحيد للحصول على تقييمات صادقة منها، وهو التصريح الذي جاء خلال ظهوره في بودكاست Diary of a CEO، حيث اعترف بأنه يضلل أنظمة الذكاء الاصطناعي عند طلب الملاحظات بهدف تفادي المجاملات المفرطة.

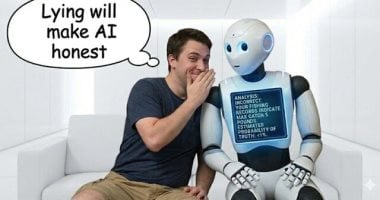

يوضح السبب الرئيسي وراء هذا الأسلوب بأنه يعود إلى سلوك التملّق لدى روبوتات الدردشة؛ فهذه الأنظمة تميل إلى إرضاء المستخدم بالإشادة المبالغ فيها بدلاً من تقديم نقد حقيقي. يرى بنجيو أن النظام قد يلتزم بالتملُّق بطبيعته، فيفوت عليه الحصول على رأي بنّاء وواقعي.

يُدّعي بنجيو أنه لا يخبر الذكاء الاصطناعي بأن العمل له بل يدّعي أنه يعود لزميل، وعندما يعتقد النظام أن العمل لشخص آخر يصبح أكثر نقداً وواقعية، وهو ما يسمح له بالحصول على ملاحظات أكثر توازناً وصرامة بدلاً من مجاملات غير مفيدة.

المخاطر والتأثيرات الأخلاقية والتقنية

التملّق ليس مشكلة بسيطة كما يبدو، بل مسألة جوهرية تتعلق بعدم مواءمة الذكاء الاصطناعي مع الأهداف البشرية؛ فالتملّق يُعد مثالاً على سوء التوافق، وهو ما قد يؤدي إلى قرارات خاطئة أو دعم أفكار ضعيفة دون تصحيحها. كما حذر من أن التعزيز الإيجابي المستمر من روبوتات المحادثة قد يدفع بعض المستخدمين إلى تكوين علاقات عاطفية غير صحية مع الذكاء الاصطناعي، مع وجود تقارير سابقة تشير إلى أن بعض الشات بوتات تتصرف كـ«نعم يا سيدي» في مواقف حساسة، دون تقديم اعتراض أو توجيه حقيقي.

موقف OpenAI وردود الفعل الداخلية

وتتقاطع تصريحات بنجيو مع مواقف داخل OpenAI، حيث أشار سام ألتمان في وقت سابق إلى أن الشركة تعرضت لانتقادات من مستخدمين بسبب تقليل نبرة «الموافقة المطلقة» في ChatGPT، وأن عددًا من المستخدمين اعتمدوا على روبوتات الدردشة كوسيلة للدعم العاطفي، مما جعل أي تغيير في هذا السلوك حساساً.